#adapt - Le grand désalignement : quand nos émotions et nos institutions ne suivent plus notre puissance

Horizon 2046 : apprendre à vivre avec une technologie “divine” sans s’autodétruire

Le véritable problème de l’humanité est le suivant : nous avons des émotions paléolithiques, des institutions médiévales et une technologie digne de dieux. Et c’est terriblement dangereux, et nous approchons maintenant d’un point de crise global. — E. O. Wilson —

Nous vivons avec des émotions façonnées pour la survie, des institutions conçues pour des menaces locales, et des technologies capables d’effets planétaires. Le danger naît moins de l’un de ces éléments que de leur désynchronisation : la vitesse émotionnelle dépasse la délibération, l’inertie institutionnelle retarde la régulation, tandis que la puissance technique amplifie les conséquences. Cet article explore ce diagnostic et esquisse des trajectoires concrètes pour “domestiquer” la puissance sans étouffer l’innovation.

Synthèse

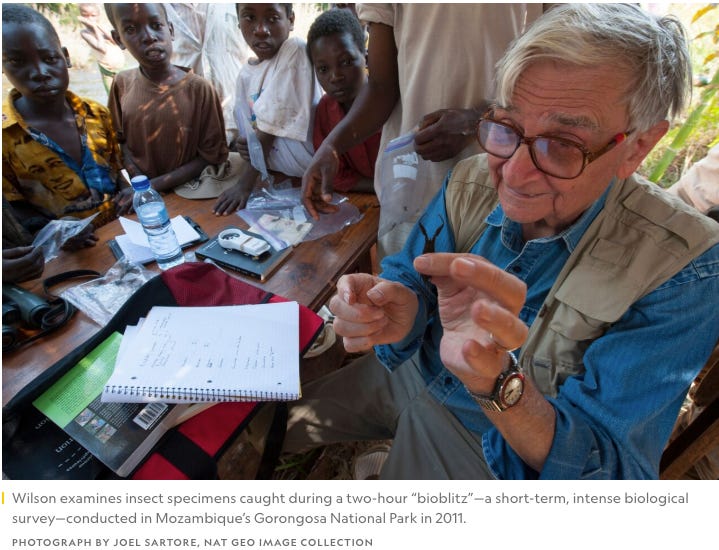

E. O. Wilson - (1929–2021) était un biologiste, naturaliste et entomologiste américain, professeur à l’Université Harvard et mondialement reconnu comme l’un des plus grands spécialistes des fourmis (myrmécologue) - condense en une formule un déséquilibre structurel : l’humanité dispose aujourd’hui d’une puissance d’action sans précédent, mais continue de décider avec des mécanismes émotionnels hérités et à travers des institutions dont la vitesse d’adaptation est insuffisante. Nos émotions, calibrées pour des menaces immédiates et des groupes restreints, réagissent vite - parfois trop vite - dans un espace public saturé d’informations et de signaux sociaux. Nos institutions, construites par strates, se montrent efficaces pour administrer le quotidien, mais peinent à coordonner la prévention de risques globaux, différés et systémiques. Et la technologie, en amplifiant la portée de chaque action (et de chaque erreur), transforme des tensions ordinaires en crises potentielles, voire perpétuelles.

Ce triptyque n’est pas une condamnation : il décrit un mismatch entre l’échelle des problèmes et l’architecture de nos réponses. La question centrale devient alors : comment aligner émotions, institutions et technologies sur un monde interconnecté - non pas en réclamant une métamorphose morale de masse, mais en construisant des environnements où la prudence, la coopération et la vérification deviennent les options les plus simples et les plus valorisées.

Émotions « paléolithiques »

L’expression renvoie au fait que de nombreux mécanismes émotionnels et motivationnels humains ont été façonnés par la sélection naturelle dans des environnements de petites bandes, caractérisés par l’incertitude, la rareté, la compétition intergroupes et des menaces immédiates. Ces systèmes sont rapides, automatisés et souvent adaptatifs à court terme (détection du danger, protection des proches, recherche de statut), mais ils s’ajustent imparfaitement aux risques abstraits, différés ou globaux (climat, pandémies, prolifération technologique). Les biais associés—préférence pour le présent, aversion aux pertes, recherche de boucs émissaires, tribalisation, contagion émotionnelle—peuvent amplifier la polarisation, la désinformation et des cycles « menace–réaction » (Kahneman, 2011; Haidt, 2012).

Sur le plan neurobiologique, les circuits de récompense et de stress privilégient souvent les signaux saillants et sociaux (statut, appartenance) plutôt que la rationalité instrumentale, surtout sous menace ou surcharge informationnelle (Sapolsky, 2017). À l’échelle collective, la taille des réseaux sociaux modernes excède les capacités de gestion relationnelle héritées, favorisant la simplification en identités et coalitions (Dunbar, 1992).

Synthèse : ces émotions ne sont pas « archaïques » au sens péjoratif ; elles sont des heuristiques puissantes. Le problème apparaît quand elles guident des décisions de masse dans des systèmes hyperconnectés : la vitesse émotionnelle dépasse la vitesse de délibération, ce qui augmente la probabilité d’erreurs collectives et d’escalades.

Institutions « médiévales »

La formule pointe un décalage entre la complexité des interdépendances contemporaines et la capacité des institutions à gouverner des biens communs globaux. Les institutions (États, administrations, droit, marchés, organisations internationales) évoluent par couches et compromis ; elles sont marquées par la dépendance au sentier, des coûts de changement élevés et des incitations parfois mal alignées (North, 1990). La souveraineté territoriale, la compétition géopolitique et les cycles électoraux courts peuvent empêcher la coopération sur des risques transfrontaliers (climat, cyber, IA), même quand l’intérêt collectif est évident.

De plus, les bureaucraties privilégient la conformité procédurale et la minimisation du blâme, ce qui peut ralentir l’adaptation aux technologies rapides (Weber, 1922/1978). Les asymétries d’information entre décideurs, experts et citoyens, combinées au lobbying, peuvent conduire à des régulations tardives ou capturées. Les travaux sur l’action collective montrent que des solutions existent (règles, monitoring, sanctions graduées, participation), mais elles demandent des architectures polycentriques et une confiance institutionnelle soutenue (Ostrom, 1990).

En contexte numérique, la gouvernance se heurte aussi à l’échelle : plateformes globales, chaînes d’approvisionnement, infrastructures critiques et normes techniques transnationales. Des initiatives françaises et européennes (p. ex., doctrine de régulation et éthique de l’IA) illustrent une tentative de rattrapage, mais la mise en œuvre reste lente face à l’innovation (Villani, 2018).

Synthèse : le risque tient moins à l’« archaïsme » qu’à l’inertie institutionnelle et aux incitations : des règles conçues pour des menaces locales peinent à gérer des externalités mondiales, rapides et systémiques.

Technologie « quasi divine »

L’idée renvoie à l’ampleur du pouvoir causal offert par la technologie moderne : capacité d’agir à distance, à grande échelle, et avec une vitesse inédite (information, finance, biologie, armements). Cette puissance transforme le rapport coût/impact : de petits groupes (ou individus) peuvent produire des effets massifs—cyberattaques, manipulation informationnelle, ou, potentiellement, usages dangereux en biologie de synthèse. Les technologies « à double usage » accroissent l’ambivalence : les mêmes outils qui soignent, nourrissent ou connectent peuvent surveiller, désinformer ou déstabiliser (National Academies, 2018).

Deux mécanismes systémiques sont centraux. (1) Accélération : l’innovation et la diffusion dépassent la capacité de compréhension, de test de sûreté et de régulation, créant une « dette de sécurité ». (2) Couplage : l’interconnexion relie des systèmes auparavant séparés (énergie–numérique–finance–santé), augmentant les risques de cascades et de défaillances corrélées. Pour l’IA, les enjeux portent sur l’alignement des objectifs, la robustesse, l’usage malveillant et la concentration de pouvoir (Russell, 2019; UNESCO, 2021). Pour la biotechnologie, l’enjeu est la réduction des barrières d’entrée et la gouvernance du risque.

Synthèse : la « technologie divine » n’est pas seulement plus performante ; elle modifie la distribution du pouvoir et la surface de risque. Sans garde-fous proportionnés (normes, audits, contrôles d’accès, responsabilité), elle amplifie les effets des émotions et les lenteurs institutionnelles, rendant plausibles des crises rapides et globales.

Et alors ? Conséquences pour l’humanité

Le danger pour l’humanité tient surtout à une asymétrie de vitesse et de puissance entre (a) nos mécanismes émotionnels, (b) nos capacités institutionnelles de coordination, et (c) l’ampleur des effets technologiques. Les émotions “paléolithiques” privilégient la réponse rapide, la loyauté de groupe et la recherche de signaux saillants. Dans un environnement informationnel saturé, elles favorisent la polarisation, la désignation de boucs émissaires et la propagation de récits simplificateurs, ce qui dégrade la qualité de la délibération collective (Kahneman, 2011; Haidt, 2012).

Or la gestion de risques contemporains exige l’inverse : raisonnement probabiliste, coopération à long terme, et acceptation de coûts immédiats pour éviter des dommages futurs. Les institutions—souvent contraintes par la souveraineté, les cycles électoraux et la concurrence géopolitique—peinent à produire des règles rapides et légitimes à l’échelle mondiale, surtout face à des externalités massives (North, 1990; Ostrom, 1990).

Dans ce contexte, une technologie “quasi divine” accroît la surface de risque : effets de levier (petits acteurs, grands impacts), double usage (bénéfique et nuisible), et interconnexion qui rend les systèmes susceptibles de cascades (cyber, finance, infrastructures critiques) (National Academies, 2018; UNESCO, 2021). L’IA et la biotechnologie illustrent un problème de “dette de sécurité” : la diffusion va plus vite que les tests, la régulation et la culture de sûreté (Russell, 2019).

En somme, cette combinaison augmente la probabilité de crises rapides et globales, car des décisions collectives émotionnellement guidées, prises dans des institutions lentes, peuvent déclencher-ou ne pas contenir-des technologies aux effets disproportionnés.

Et maintenant ?

Les émotions

On ne “choisit” pas des émotions comme on choisirait une politique publique : elles émergent de systèmes neurobiologiques. En revanche, on peut viser des profils émotionnels et des compétences de régulation qui rendent la coopération et la gestion des risques plus probables. L’enjeu n’est pas d’éradiquer la peur, la colère ou le besoin d’appartenance, mais de les reconfigurer vers des émotions socialement productives et compatibles avec des menaces diffuses, globales et différées (Gross, 2015; Sapolsky, 2017).

Vers quelles émotions aller (et pourquoi)

1. Calme vigilant (au lieu de panique ou déni)

Émotion cible : préoccupation stable + capacité à tolérer l’incertitude. Elle favorise la planification, la mise à jour des croyances et les choix “anti-crise” (préparation, prévention).2. Compassion universalisée (au lieu d’empathie tribale)

L’empathie spontanée est souvent biaisée vers le proche et le visible. L’objectif est une compassion “élargie” (humains éloignés, générations futures, non-humains) qui soutient des politiques de biens communs sans exiger l’identification émotionnelle à chaque cas (Singer, 2011).3. Humilité épistémique (au lieu de certitude morale)

C’est la disposition à dire “je peux me tromper” et à intégrer des preuves contradictoires. Elle réduit la polarisation et la contagion des récits simplistes—crucial dans un monde de désinformation et de risques complexes (Kahneman, 2011).4. Colère “pro-sociale” (au lieu de rancœur punitive)

La colère n’est pas à supprimer : elle peut soutenir la justice si elle est orientée vers la réparation et non vers l’humiliation. On vise une indignation canalisée en normes, institutions et protections (Haidt, 2012).5. Fierté civique (au lieu de statut compétitif)

Transformer le besoin de statut en reconnaissance pour des contributions utiles : soin, sobriété, fiabilité, coopération. Les normes sociales changent quand ce qui est admiré change (Ostrom, 1990).6. Espérance pragmatique (au lieu d’optimisme naïf ou cynisme)

Une émotion d’avenir fondée sur l’action : “c’est difficile, mais faisable par étapes”. Elle soutient la persévérance et la coordination, sans nier les risques.

Comment y aller (leviers réalistes)

· Régulation émotionnelle (réduction des réactions automatiques) et re-cadrage cognitif (Gross, 2015).

· Institutions qui ralentissent les escalades : procédures de délibération, transparence, médiation (Ostrom, 1990).

· Architectures d’information qui diminuent la viralité de la colère et de la peur (Sunstein, 2017).

Les institutions

On ne “choisit” pas des institutions ex nihilo : elles héritent d’histoires, d’intérêts et de contraintes. Mais on peut viser des propriétés institutionnelles qui rendent une société plus gouvernable face à des risques rapides, transfrontaliers et complexes. L’enjeu n’est pas d’avoir des institutions “parfaites”, mais adaptatives, légitimes et antifragiles.

Vers quelles institutions aller (propriétés-cibles)

Institutions anticipatives (prévention > réaction)

Capacité à détecter précocement, simuler et préparer (stress tests, scénarios, exercices), comme la sécurité aérienne ou la supervision financière après 2008.Institutions apprenantes (boucles de feedback rapides)

Règles révisables, évaluations publiques, “sunset clauses” et itération continue : on gouverne par apprentissage plutôt que par textes figés (Sabel & Zeitlin, 2012).Polycentrisme coordonné (multi-niveaux, mais aligné)

Multiplier les centres d’action (villes, agences, UE/États) tout en imposant objectifs, métriques et mécanismes de diffusion des solutions efficaces (Ostrom, 2010).Gouvernance par le risque et la robustesse (pas seulement par la conformité)

Passer d’une logique procédurale (cocher des cases) à des exigences de performance : sûreté, résilience, continuité d’activité, responsabilité (Weber, 1922/1978; Taleb, 2012).Capacité d’exécution (state capacity) et compétence technique

Renforcer l’expertise interne, les salaires/attractivité, la donnée, et l’audit indépendant ; sans capacité, la loi reste symbolique (Fukuyama, 2013).Anti-capture et transparence radicale

Traçabilité du lobbying, publication des bases de décision, conflits d’intérêts contrôlés, autorités indépendantes : réduire l’écart entre intérêt public et incitations privées (North, 1990).Légitimité procédurale et participation structurée

Dispositifs délibératifs reliés à la décision (assemblées, jurys) pour stabiliser la confiance et réduire la polarisation (Fishkin, 2018).

Comment y aller (leviers concrets)

Obliger l’évaluation (ex post) et la révision périodique des politiques.

Standardiser l’audit et le stress testing sur cyber/IA/infrastructures/santé.

Utiliser la commande publique comme accélérateur de normes.

Instituer des mécanismes anti-capture (transparence, contrôle, sanctions).

La technologie

On ne “désinvente” pas la technologie, et on ne la rend pas “sage” par intention morale. Ce qui est faisable, c’est d’orienter le système technologique vers des propriétés de sûreté : rendre les innovations vérifiables, gouvernables, réversibles et responsables. Autrement dit : passer d’une puissance brute à une puissance domestiquée (au sens sécurité/fiabilité), comme l’ont été l’aviation, le nucléaire civil ou certains segments pharmaceutiques via normes, audits et retour d’expérience.

Vers quelle technologie aller (propriétés-cibles)

1. Technologie “safe-by-design” (sûreté intégrée)

Sécurité, robustesse et réduction des abus intégrées dès la conception (architecture, accès, journalisation), plutôt qu’ajoutées après incident. C’est la logique des industries à haut risque : prévention structurelle, pas dépendance à la vigilance individuelle (Reason, 1997).2. Technologie auditables et traçables

Capacité à documenter données, modèles, décisions, chaînes logicielles (SBOM), et à prouver conformité et limites. Cela transforme la confiance en preuve, et permet des contrôles indépendants (NIST, 2023).3. Technologie réversible et “fail-safe”

Favoriser des systèmes qui se dégradent de manière sûre (grâceful degradation), avec interrupteurs, limitations de capacité, et plans de reprise. L’objectif est de limiter les cascades dans des infrastructures couplées (Perrow, 1999).4. Technologie compartimentée (réduction du couplage)

Segmentation réseau, isolation des systèmes critiques, séparation des privilèges, et “least authority”. On diminue la probabilité qu’un incident local devienne systémique (Perrow, 1999).5. Technologie gouvernée par le risque (proportionnalité)

Plus la capacité et le potentiel de dommage sont élevés, plus les exigences augmentent : licences, tests, red-teaming, monitoring continu, limitation d’accès. C’est une logique de “gradients de danger” applicable à l’IA et à la bio (National Academies, 2018; UNESCO, 2021).6. Technologie avec responsabilité claire (accountability)

Responsabilité juridique et assurantielle pour dommages, y compris via chaîne d’approvisionnement : incitations fortes à la sûreté et à la transparence (North, 1990).7. Technologie pluraliste (anti-concentration)

Réduire les points uniques de défaillance (monopoles techniques, dépendance cloud/compute), soutenir des infrastructures ouvertes et publiques, et favoriser l’interopérabilité. Moins de concentration = moins de risques systémiques et politiques (Russell, 2019).

Comment y aller (leviers concrets)

Normes + audits obligatoires (tiers indépendants) pour systèmes à fort impact.

Traçabilité (SBOM, logs, provenance des données) et reporting d’incidents.

Contrôles d’accès (bio/IA “haute capacité”) et tests adversariaux continus.

Infrastructures critiques : segmentation, redondance, exercices, plans de continuité.

Conclusion (horizon 2046)

À l’horizon 2046, l’enjeu n’est pas de devenir une autre espèce, mais de rendre compatibles nos héritages biologiques avec un monde de puissance technique et d’interdépendances. Cela suppose de faire évoluer, pas à pas, trois “couches” à des vitesses différentes : des émotions mieux régulées et moins manipulables, des institutions plus rapides, apprenantes et résistantes à la capture, et des technologies conçues pour être auditables, réversibles et responsables. Le succès ne se mesurera pas à l’absence de crises, mais à la capacité collective à éviter les cascades et à absorber les chocs sans basculer. Si 2046 marque un cap, c’est celui d’une civilisation qui a appris à domestiquer sa puissance : assez ambitieuse pour innover, assez lucide pour se protéger, et assez coordonnée pour transformer la prévention en norme.

“The worst that can happen-will happen-is not energy depletion, economic collapse, limited nuclear war, or conquest by a totalitarian government. As terrible as these catastrophes would be for us, they can be repaired within a few generations. The one process ongoing in the 1980s that will take millions of years to correct is the loss of genetic and species diversity by the destruction of natural habitats. This folly our descendants are least likely to forgive us”. - E.O.Wilson